파이콘 코리아 2018 후기

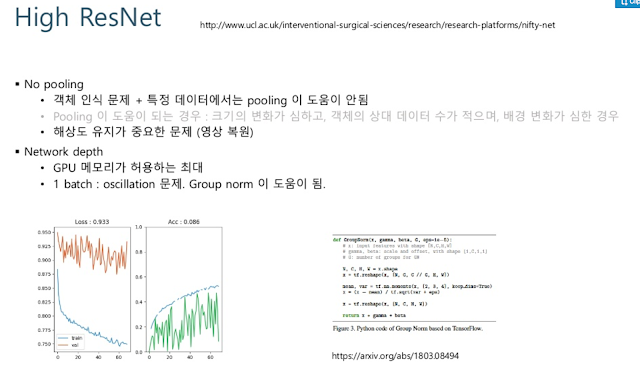

파이콘 코리아 2018 지난 2018/08/18(토) ~ 19(일)에 파이콘이 개최되었고, 회사에서 지원을 받아서 다녀오게 되었습니다. https://www.pycon.kr/2018/ 대부분의 머신러닝에 관한 세션을 들었고, 그에 대하여 한 포스팅에 상세히 설명은 어렵지만 간단한 후기 등을 작성 하려고 합니다. 혹시라도.. 이 글을 읽게 되실 분들 중, 이 세션은 내 발표인데 포스팅 안했으면 좋겠다 싶으신 분들은 바로 댓글 부탁드립니다. 세션들을 블로그에 박제(?) 하려는 의도는 아니고, 지난 파이콘 세션들이 기억이 안나는 나에 대한 채찍질일 뿐 입니다. 머신러닝으로 치매 정복하기 링크 : https://www.pycon.kr/2018/program/36 슬라이드 : https://www.slideshare.net/ParkSejin/2018-110482902 치매, 알츠하이머는 치료가 어렵고, 조기 진단을 통해서 진행 속도를 늦추는 정도에 불과 하다. 모든 성인은 노화 하면서 뇌가 위축이 되고, 치매가 걸리는 사람들은 뇌의 특정한 위치에서 다른 변화가 있을 것이며 이를 찾는것이 프로젝트의 목적. 상용 프로젝트는 성능이 안나오거나 기능이 부족한게 현실이다. 속도가 나오며, 진단을 통한 위험도를 제시하며, 뇌의 영역을 시각화 하는것이 해당 프로젝트의 차별점. 해상도가 중요한 데이터에서 사용하는 High ResNet 일반적인 CNN 은 pooling을 통하여 레이어를 점차 작게 하면서 데이터를 축소 시키지만, 해당 문제에서는 객체가 인식 되어야 해서 해상도가 필요한데 이러한 이미지 인식에 사용되는 방식은 High ResNet. resnet의 구조는 중간에 뛰어넘는 지름길의 path를 두어서 성능을 향상 시켰다고 합니다. resnet 구조 소설 쓰는 딥 러닝 링크 : https://www.pycon.kr/2018/program/28 슬라이드 : https...